Los vehículos aéreos no tripulados (VANT), o drones, están transformando la agricultura moderna al proporcionar vistas aéreas rápidas de los campos. Se utilizan para inspeccionar los cultivos y evaluar su estado de salud, etapa de crecimiento, plagas, malezas y rendimiento. Por ejemplo, China cuenta actualmente con más de 250 000 drones agrícolas en operación, y en Tailandia, aproximadamente 301 TP3T de tierras de cultivo fueron cubiertas mediante fumigación o monitoreo con drones para 2023. Estos VANT hacen que la agricultura sea más eficiente al detectar rápidamente problemas (como brotes de plagas o estrés hídrico) que podrían pasar desapercibidos en tierra.

Sin embargo, los UAV pequeños tienen una capacidad de procesamiento y una autonomía de batería muy limitadas. Por lo tanto, ejecutar algoritmos complejos de visión artificial en tiempo real resulta todo un reto. Los modelos tradicionales de detección de objetos ligeros (como los detectores basados en YOLO o MobileNet) solo satisfacen parcialmente estas necesidades: a menudo sacrifican precisión o velocidad y requieren una importante configuración manual. Esta limitación impulsa el desarrollo de la Búsqueda de Arquitectura Neuronal (NAS), un método de diseño automatizado que adapta los modelos de aprendizaje profundo a los requisitos específicos de los UAV desplegados en campo.

La agricultura de precisión moderna utiliza vehículos aéreos no tripulados (drones) para inspeccionar los campos y monitorear el estado de los cultivos. Al sobrevolar grandes extensiones, los drones pueden capturar imágenes de alta resolución de las plantas, el suelo y la distribución del terreno. Estas imágenes se procesan mediante algoritmos de visión artificial que detectan malezas entre los cultivos, estiman el rendimiento (por ejemplo, contando frutos o espigas) o identifican los primeros signos de enfermedades o deficiencias nutricionales. Por ejemplo, los drones permiten la aplicación selectiva de herbicidas en zonas con malezas, reduciendo así el uso de productos químicos y los costos asociados.

Sin embargo, los pequeños ordenadores de a bordo de los drones (a menudo con una potencia limitada a unos pocos vatios) tienen dificultades para ejecutar grandes redes neuronales a velocidad de vuelo. Esto dificulta el análisis en tiempo real: si un dron detecta un problema, necesita reaccionar rápidamente o registrar los datos antes de que se agote la batería. Los detectores ligeros actuales (por ejemplo, YOLOv8 nano, YOLO-tiny, MobileNets) se diseñan manualmente y suelen implicar ciertas limitaciones: al reducir el tamaño del modelo se acelera su funcionamiento, pero puede perjudicar la precisión.

En consecuencia, existe una gran necesidad de métodos que encuentren automáticamente el mejor modelo posible dadas las limitaciones del UAV. El sistema NAS con enfoque en el despliegue satisface esta necesidad al buscar arquitecturas de redes neuronales que optimicen conjuntamente la precisión de detección y el uso de recursos (latencia, energía, memoria) en condiciones reales de UAV. Este enfoque puede proporcionar modelos especializados que se ejecutan de manera eficiente en el hardware del dron y, al mismo tiempo, mantienen una alta precisión para las tareas de monitoreo de cultivos.

Requisitos de detección de objetos mediante UAV en la monitorización de cultivos

Los vehículos aéreos no tripulados (UAV) agrícolas realizan diversas tareas de detección visual, cada una con sus propias exigencias:

1. Detección de la salud y el estrés en los cultivos: Los drones utilizan cámaras RGB, térmicas o multiespectrales para identificar plantas estresadas, deficiencias de nutrientes o síntomas de enfermedades. Los algoritmos en tiempo real permiten mapear la variabilidad del campo y orientar el riego o la fertilización. La detección precisa de los signos de estrés en las plantas posibilita intervenciones oportunas para salvar la cosecha.

2. Identificación de malezas: La detección de malezas entre los cultivos permite a los agricultores rociar solo las plantas no deseadas, ahorrando herbicidas. Por ejemplo, un estudio en campos de algodón utilizó imágenes de drones con un detector basado en YOLOv7 y logró una precisión de aproximadamente 83% al separar las malezas del algodón. Sin embargo, distinguir visualmente malezas y cultivos similares sigue siendo difícil en imágenes de campo con muchos detalles.

3. Detección de plagas y enfermedades: Los vehículos aéreos no tripulados (UAV) pueden detectar brotes (por ejemplo, de langostas, insectos o enfermedades fúngicas) antes que los humanos a pie. Los drones también permiten mapear zonas infestadas de plagas mediante imágenes multiespectrales, lo que mejora la calidad de las imágenes RGB. La detección rápida y precisa de plagas es fundamental para prevenir su propagación.

4. Estimación del rendimiento: Contar frutas, espigas de grano o plantas desde el aire ayuda a predecir los volúmenes de cosecha. Los modelos entrenados para detectar manzanas, melones o espigas de trigo en imágenes de drones pueden acelerar la estimación del rendimiento. Por ejemplo, se han utilizado redes neuronales en imágenes de drones para contar cultivos de sandía y melón en los campos.

5. Topografía y cartografía: Los drones también crean mapas de campo (topografía, diferencias del suelo) que ayudan a planificar el cultivo. Si bien no se trata estrictamente de detección de objetos, esto forma parte de la monitorización mediante vehículos aéreos no tripulados (UAV).

Estas tareas suelen requerir inferencia casi en tiempo real: un dron que sobrevuela campos puede necesitar procesar fotogramas de vídeo sobre la marcha (varios fotogramas por segundo) para poder tomar decisiones de control (como ajustar la altitud o activar un pulverizador) de inmediato. En otros casos, pequeños retrasos (de segundos) pueden ser aceptables si los datos se registran y analizan después del aterrizaje.

Es fundamental que la visión de los UAV pueda gestionar la variabilidad ambiental: luz solar intensa, sombras, desenfoque por movimiento causado por el viento, oclusión por hojas superpuestas o cambios de altitud y ángulo. El tamaño de los objetos varía (desde maleza en primer plano hasta grupos de plagas a distancia), por lo que los detectores deben gestionar características a diferentes escalas.

Finalmente, las misiones agrícolas con UAV implican un equilibrio estricto entre precisión, latencia y consumo de energía. Se requiere una alta precisión de detección para evitar pasar por alto malezas o plagas, pero el uso de una red neuronal muy profunda puede agotar rápidamente la batería. Por lo tanto, un modelo de detección debe ser rápido y eficiente energéticamente, sin dejar de ser lo suficientemente preciso para la tarea. Estos exigentes requisitos ponen de manifiesto la necesidad de un diseño de modelos especializado para UAV en la agricultura.

Detectores de objetos ligeros para plataformas UAV

Los detectores de objetos ligeros son redes neuronales diseñadas específicamente para funcionar en hardware limitado. Suelen utilizar arquitecturas pequeñas (como MobileNet o ShuffleNet), capas de ancho reducido o diseños de cuello/cabeza simplificados. Por ejemplo, los modelos de la familia YOLO incluyen versiones "nano" y "tiny" (como YOLOv8n y YOLOv5s) que tienen menos parámetros y requieren menos operaciones (FLOPs).

Estos detectores pueden funcionar a decenas de fotogramas por segundo en hardware integrado como NVIDIA Jetson Nano o Google Coral. Por ejemplo, Ag-YOLO era un detector personalizado basado en YOLO para plantaciones de palma que funcionaba a 36,5 fps en un Intel Neural Compute Stick 2 (consumiendo solo 1,5 W) y alcanzaba una alta precisión (F1 = 0,9205). Este modelo utilizaba aproximadamente 12 veces menos parámetros que YOLOv3-Tiny, duplicando su velocidad.

Estos ejemplos ilustran las ventajas y desventajas del diseño de modelos: reducir el tamaño o la complejidad de un modelo (por ejemplo, menos capas o canales) suele acelerar la inferencia y disminuir el consumo de energía, pero puede reducir la precisión. Ag-YOLO sacrificó cierta capacidad para ganar velocidad y eficiencia, y aun así mantuvo una alta puntuación F1 de 0,92 en su tarea.

De forma similar, se compararon tres variantes de YOLOv7 para la detección de maleza: la versión completa de YOLOv7 alcanzó una precisión de 83%, mientras que una versión más pequeña, YOLOv7-w6, obtuvo una precisión de 63%. Esto ilustra una limitación de los detectores ligeros genéricos: los modelos optimizados para un entorno o tipo de objeto pueden tener un rendimiento inferior en otro. Un detector optimizado para la velocidad podría pasar por alto indicios sutiles (por ejemplo, maleza pequeña o camuflada), lo que perjudica su robustez en diversas condiciones.

En agricultura, estas redes genéricas ligeras pueden no ser óptimas sin ajustes adicionales. Por ejemplo, un modelo YOLOv7 preentrenado con conjuntos de datos comunes podría no manejar a la perfección las texturas y escalas únicas de las imágenes de cultivos. Por lo tanto, es necesario optimizar la arquitectura del modelo según la tarea y la plataforma. El ajuste manual (cambio de capas, filtros, etc.) para cada nuevo tipo de dron o variedad de cultivo requiere mucho trabajo. Esto impulsa el desarrollo de métodos automatizados, como NAS con reconocimiento de despliegue, para encontrar el mejor equilibrio entre tamaño, precisión y robustez para una plataforma de UAV y una aplicación agrícola determinadas.

Búsqueda de arquitectura neuronal en sistemas de visión basados en vehículos aéreos no tripulados

La búsqueda de arquitectura neuronal (NAS, por sus siglas en inglés) es un método automatizado para diseñar arquitecturas de redes neuronales. En lugar de configurar manualmente el número de capas, filtros y conexiones, NAS utiliza algoritmos (aprendizaje por refuerzo, métodos evolutivos o búsqueda basada en gradientes) para explorar un espacio de posibles diseños y encontrar aquellos que optimicen un objetivo elegido (como la precisión).

La arquitectura NAS ya se ha aplicado para crear redes optimizadas para dispositivos móviles. Por ejemplo, MnasNet de Google fue una NAS pionera que, al considerar la plataforma, incluyó directamente la latencia real del dispositivo en su objetivo. MnasNet midió el tiempo de inferencia en un teléfono Google Pixel para cada modelo candidato durante la búsqueda y comparó la precisión con esta latencia medida. El resultado fue una familia de CNN rápidas y precisas en hardware móvil, superando a los modelos MobileNet y NASNet diseñados manualmente en ImageNet.

Sin embargo, los enfoques genéricos de NAS, como MnasNet, se centran en tareas de visión generales (clasificación de ImageNet o detección de COCO) y hardware genérico (por ejemplo, teléfonos móviles). Para la monitorización de cultivos con UAV, el problema es más específico. Necesitamos detectores optimizados para clases de objetos específicas (plantas, malezas, plagas) y adaptados a los sensores y al perfil de vuelo del UAV. Un NAS estándar que solo optimiza la precisión o la latencia genérica puede pasar por alto matices como la detección de objetos pequeños o las limitaciones energéticas.

Además, los métodos tradicionales de NAS pueden ser computacionalmente muy costosos (a menudo requieren días en grandes clústeres de GPU), lo que no siempre resulta práctico para los investigadores agrícolas. Por lo tanto, se necesitan marcos de trabajo NAS específicos para la visión de los UAV. Estos deben incorporar criterios relevantes para los UAV y ser lo más eficientes posible.

En todos los casos, es fundamental tener en cuenta las restricciones: el sistema de acceso a la red (NAS) debe conocer las limitaciones del dispositivo objetivo (de forma similar a MnasNet) y las exigencias en tiempo real de las tareas del UAV en vuelo. Si la búsqueda es demasiado lenta o ignora el consumo de energía, es posible que el modelo resultante no funcione correctamente en la práctica.

En la práctica, el NAS para la visión de los UAV incluiría la latencia del hardware y el consumo de energía directamente en la métrica de búsqueda. Por ejemplo, se podría medir la velocidad de fotogramas de un detector candidato en el ordenador del dron (como un NVIDIA Jetson) y utilizarla como puntuación. Esto contrasta con el uso de indicadores indirectos simples como los FLOPs, que no reflejan la velocidad real.

De este modo, el NAS puede descubrir arquitecturas que aprovechen al máximo las capacidades del dispositivo. En resumen, el NAS ofrece una forma de diseñar automáticamente detectores para UAV, pero debe adaptarse para tener en cuenta las tareas y los requisitos de eficiencia específicos de los UAV.

NAS con reconocimiento de despliegue: Principios básicos

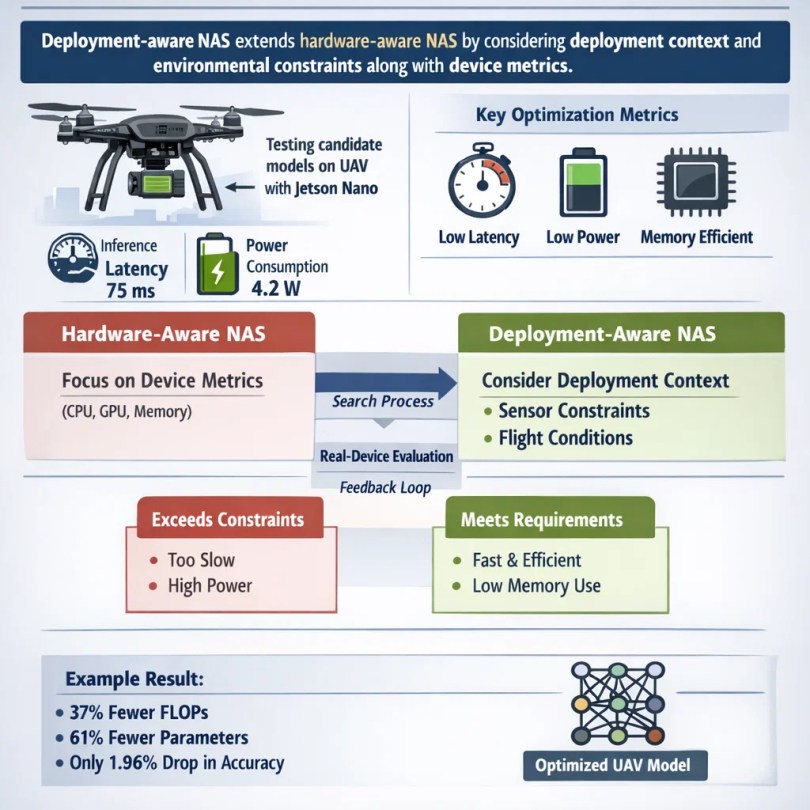

El NAS con reconocimiento de despliegue amplía el NAS con reconocimiento de hardware al incluir el contexto de despliegue y las restricciones ambientales en el proceso de diseño. En otras palabras, no solo considera el hardware del dron (velocidad de CPU/GPU, límites de memoria, presupuesto de energía), sino también las condiciones reales que encontrará el UAV en el campo. Esto implica optimizar explícitamente métricas como la latencia de inferencia en el dispositivo objetivo, el consumo de energía y el uso de memoria, sin dejar de buscar una alta precisión de detección.

Por ejemplo, durante el NAS se podría desplegar cada modelo candidato en un Jetson Nano acoplado al UAV y registrar su tiempo de inferencia y consumo de energía en condiciones reales. Esta retroalimentación empírica ayuda a orientar la búsqueda hacia modelos que realmente cumplan con los criterios de despliegue.

Los sistemas NAS que tienen en cuenta el hardware (como MnasNet) se centran en las métricas del dispositivo, mientras que los sistemas NAS que tienen en cuenta el despliegue van más allá: pueden considerar las características de entrada del sensor (por ejemplo, la resolución de la imagen, los canales multiespectrales) y los objetivos de latencia de la aplicación (fotogramas por segundo necesarios). Incluso pueden incorporar restricciones de vuelo, como la memoria máxima permitida, o incluir evaluaciones bajo simulación de vibraciones por viento o desenfoque por movimiento.

Un sistema NAS optimizado para el despliegue podría penalizar las arquitecturas que superen, por ejemplo, los 5 W de consumo energético o que requieran más memoria de la que dispone el dron. De este modo, la búsqueda se orienta naturalmente hacia modelos prácticos para las operaciones de campo del UAV. En esencia, un sistema NAS optimizado para el despliegue busca cerrar el círculo entre el diseño del modelo y su uso en el mundo real. En lugar de elegir una arquitectura de forma aislada y esperar que funcione, incluye sistemáticamente pruebas con dispositivos reales durante la búsqueda.

Por ejemplo, Kerec et al. (2026) utilizaron un marco de trabajo similar para buscar un detector de UAV: se basaron en una base YOLOv8n, pero incluyeron la latencia y la energía de Jetson Nano en la búsqueda. El modelo resultante tenía 37% menos GFLOPs y 61% menos parámetros que YOLOv8n, con una caída de solo 1,96% en mAP. Esto demuestra claramente cómo las limitaciones de despliegue llevaron al NAS a una red mucho más ligera y rápida.

Función de los sistemas NAS con reconocimiento de despliegue en la monitorización de la agricultura de precisión

Los sistemas de acceso a redes (NAS) adaptados al entorno de vuelo pueden mejorar significativamente la monitorización de cultivos mediante UAV, al personalizar los detectores según las condiciones agrícolas. Por ejemplo, la búsqueda puede priorizar arquitecturas que destaquen en la detección de objetos pequeños y delgados (como maleza estrecha o plántulas de maíz finas) o en la distinción de plantas del suelo. Pueden ajustar la profundidad de la red y los campos receptivos a la altura de vuelo habitual: a baja altitud, los objetos ocupan toda la imagen y pueden requerir detalles finos, mientras que a mayor altitud la red debe ser eficaz en la detección a pequeña escala. Un NAS adaptado al entorno de vuelo puede incorporar estos requisitos en su espacio de búsqueda.

La velocidad es crucial en el campo. Imaginemos que un dron detecta un brote de plagas; si el modelo es lo suficientemente rápido como para procesar vídeo a, por ejemplo, 30 fps, puede alertar al piloto o activar una acción de tratamiento inmediata. En las pruebas, un modelo diseñado por NAS funcionó 28% más rápido en una Jetson Nano que el YOLOv8n estándar, gracias a su arquitectura optimizada. Además, consumió 18,5% menos de energía durante el tiempo de ejecución de ONNX, lo que significa que el dron puede volar durante más tiempo con la misma batería. Estas ventajas facilitan la toma de decisiones en vuelo y prolongan la duración de la misión.

La robustez es otra ventaja. Dado que el NAS, adaptado al entorno de implementación, implica la evaluación de dispositivos reales, la búsqueda puede incluir pruebas en diversas condiciones. Por ejemplo, podría simular condiciones de poca luz o incluir imágenes de entrenamiento del amanecer y el atardecer, lo que garantiza que el detector final mantenga su precisión ante cambios reales de clima e iluminación. El trabajo demostró que el detector derivado del NAS se generaliza bien: lo probaron con dos conjuntos de datos de cultivos diferentes (espigas de trigo y plántulas de algodón) y obtuvieron un rendimiento excelente en ambos.

Esto sugiere que el sistema NAS con enfoque en el despliegue ayudó a identificar características comunes y útiles para la agricultura, mejorando su generalización a nuevos campos. En general, el sistema NAS con enfoque en el despliegue ayuda a equilibrar la precisión con un mayor tiempo de vuelo. Al reducir la carga computacional, los drones consumen menos energía y pueden cubrir una mayor área con una sola carga de batería, sin dejar de detectar cultivos y plagas de forma fiable.

Diseño del espacio de búsqueda para detectores de UAV agrícolas

Una parte importante de los sistemas NAS con capacidad de implementación es el espacio de búsqueda: el conjunto de posibles diseños de red que considera. Para los detectores de cultivos mediante UAV, el espacio de búsqueda se puede diseñar para incluir arquitecturas prometedoras para este ámbito. Los elementos clave incluyen:

1. Diseño de la estructura principal: El núcleo del sistema es el extractor de características. Para los UAV, se podrían incluir bloques de construcción convolucionales ligeros, como convoluciones separables en profundidad (como las utilizadas en MobileNet) o bloques residuales invertidos. Los residuos invertidos y los cuellos de botella lineales (al estilo de MobileNetV2) son conocidos por su eficiencia en dispositivos móviles. El espacio de búsqueda podría permitir variar el ancho (número de canales) y la profundidad de cada bloque para ajustarse al presupuesto computacional del UAV. También se podrían incluir módulos de atención o inspirados en transformadores si el UAV puede soportarlos con bajo consumo de energía.

2. Diseño del cuello: Muchos detectores de objetos utilizan pirámides de características (FPN) o redes de agregación de rutas para combinar características multiescala. La búsqueda podría explorar FPN simplificadas o agregación de características ligera. Por ejemplo, el uso de un cabezal de escala única frente a cabezales multiescala podrían ser opciones. El espacio podría permitir capas de agrupación o conexiones de salto que ayuden a detectar objetos de diferentes tamaños.

3. Diseño de la cabeza: El cabezal de detección (capas de clasificación y regresión de cajas) también puede variar. Para drones que observan campos uniformes, un cabezal más simple podría ser suficiente. Pero para detectar maleza pequeña, la búsqueda podría incluir capas convolucionales adicionales o diferentes esquemas de anclaje.

4. Operaciones ligeras: El espacio de búsqueda puede permitir explícitamente solo operaciones de bajo costo. Por ejemplo, elegir entre una convolución de 3×3 frente a una convolución factorizada de 1×3+3×1 más económica, o incluir módulos de GhostNet. También puede permitir tamaños de kernel pequeños o dimensiones reducidas para limitar el cálculo. Todas estas decisiones están determinadas por el hardware. El espacio puede prohibir cualquier configuración de capa que exceda el límite de memoria del dron o el umbral de energía previsto.

Mediante un diseño meticuloso de este espacio de búsqueda, el proceso NAS se orienta hacia arquitecturas eficaces y eficientes. El resultado podría ser una combinación novedosa de bloques no contemplada en los modelos estándar. El mejor detector encontrado utilizó bloques personalizados que redujeron los GFLOP en 37% y los parámetros en 61% en comparación con YOLOv8n.

Esto fue posible gracias a que el NAS podía combinar elementos de la red troncal y del cabezal, teniendo en cuenta las limitaciones del UAV. En resumen, la búsqueda de detectores de UAV agrícolas se centra en módulos escalables y ligeros, así como en la gestión a múltiples escalas, todo ello dentro de los límites del hardware integrado.

Objetivos y restricciones de optimización

Los sistemas de detección de plagas (NAS) adaptados a la implementación deben gestionar múltiples objetivos. El principal suele ser la precisión de detección (p. ej., precisión media promedio, mAP), medida en conjuntos de datos de monitorización de cultivos. Por ejemplo, mAP@50 (precisión a 50% IOU) es una métrica común. El modelo optimizado para NAS solo presentó una disminución de 1,96% en mAP@50 en comparación con el modelo base YOLOv8n, una pérdida mínima para las mejoras obtenidas. También se consideran la precisión y la exhaustividad (o puntuación F1) en las clases clave (malezas, cultivos).

Al mismo tiempo, es necesario optimizar la latencia y el consumo de energía. La latencia es el tiempo de inferencia por imagen; para una GPU integrada, puede ser de 20 a 50 ms o más. Una menor latencia implica una mayor velocidad de fotogramas. El consumo de energía (julios por fotograma) es crucial para la autonomía de vuelo. El espacio de memoria (número de parámetros, tamaño del modelo) es otra limitación; los modelos deben caber en la RAM del dispositivo. Por lo tanto, el NAS suele establecer un objetivo o una penalización para estas limitaciones.

Por ejemplo, cualquier modelo más lento que un determinado umbral o que supere un límite de parámetros podría ser relegado a un segundo plano. Esto convierte, en la práctica, el NAS en un problema de optimización multiobjetivo: maximizar la precisión minimizando la latencia, el consumo de energía y el tamaño.

En la práctica, esto podría lograrse mediante una suma ponderada de objetivos o mediante restricciones estrictas. Algunos métodos penalizan considerablemente a cualquier candidato que supere el límite de potencia del UAV. Otros calculan explícitamente una métrica energética: se probaron modelos en el entorno de ejecución ONNX para medir la "eficiencia energética", y el mejor modelo resultó ser 18,5% más eficiente energéticamente que YOLOv8n. Este fue uno de los objetivos que guiaron su búsqueda.

Las compensaciones encontradas pueden visualizarse en una frontera de Pareto: en un extremo, modelos pequeños extremadamente rápidos con menor precisión; en el otro, modelos grandes y precisos que son demasiado lentos o consumen demasiada energía para un dron. El NAS, concebido para su despliegue, busca un punto óptimo en esta frontera que se ajuste a las prioridades reales de la misión (por ejemplo, una ligera pérdida de precisión a cambio de una gran aceleración). En resumen, el NAS debe considerar conjuntamente las métricas de precisión (mAP, F1) y las restricciones de inferencia (ms por fotograma, julios por fotograma, memoria). Esta optimización equilibrada es lo que hace que un modelo esté realmente listo para su despliegue en UAV.

Capacitación y evaluación en entornos agrícolas reales.

Para que los detectores encontrados por el NAS funcionen correctamente, deben entrenarse y probarse con datos agrícolas realistas. Esto implica utilizar conjuntos de datos que capturen la variabilidad de los campos reales: diferentes especies de cultivos, etapas de crecimiento, estaciones, condiciones de iluminación y altitudes. Por ejemplo, el entrenamiento con imágenes de solo brotes jóvenes de maíz puede no ser generalizable a espigas de trigo maduras. Los conjuntos de datos representativos del campo garantizan que el modelo aprenda las características relevantes en la explotación agrícola. También se puede aplicar la ampliación de datos (cultivos aleatorios, cambios de brillo, desenfoque por movimiento) durante el entrenamiento para simular el movimiento y la iluminación de los drones.

Al evaluar, es importante probar el modelo en condiciones lo más realistas posible. Las herramientas de simulación pueden ser útiles (por ejemplo, volar un dron virtual sobre campos 3D), pero las pruebas de vuelo reales son el método de referencia. La evaluación comparativa a bordo se realiza ejecutando el modelo en el hardware real del UAV. Después de NAS, implementaron el modelo candidato en un Jetson Nano y midieron una inferencia 28.1% más rápida (en comparación con la versión base YOLOv8n) y un mejor consumo de energía. Este tipo de retroalimentación en dispositivos reales confirma que la búsqueda produjo un modelo que realmente cumple con los requisitos.

La generalización también es crucial. Un modelo puede buscarse y entrenarse en un cultivo (por ejemplo, trigo), pero los agricultores necesitan detectores que funcionen en diferentes campos. El estudio demostró una sólida generalización entre cultivos: el detector derivado de NAS, entrenado en una tarea, siguió funcionando bien en un conjunto de datos de otro cultivo (plántulas de algodón) sin necesidad de reentrenamiento. Esto sugiere que los sistemas NAS adaptados al entorno de implementación pueden generar arquitecturas robustas. Sin embargo, los cambios de dominio (por ejemplo, pasar de campos de maíz a huertos frutales) pueden requerir ajustes o búsquedas adicionales. También se recomienda realizar pruebas entre temporadas (imágenes de verano y otoño).

Finalmente, cada nuevo modelo debe someterse a pruebas comparativas en la plataforma de UAV antes de su despliegue. Esto incluye registrar su precisión y velocidad en drones, asegurar que no sobrecaliente el hardware y verificar el consumo de energía. Solo entonces los agricultores podrán confiar en él para el monitoreo crítico de la misión. Al combinar capacitación relevante para el campo y una evaluación rigurosa del hardware, NAS, concebido para el despliegue, produce detectores que no solo son teóricamente eficientes, sino que también han demostrado su eficacia en el campo.

Ventajas sobre los detectores de UAV diseñados manualmente

Los sistemas NAS con reconocimiento de despliegue ofrecen varias ventajas claras sobre los modelos tradicionales diseñados manualmente para UAV:

1. Mejores compensaciones en el rendimiento: Los modelos encontrados por NAS tienden a ofrecer combinaciones más eficientes en precisión, velocidad y consumo de energía. Por ejemplo, el mejor modelo se ejecutó 28% más rápido y consumió 18,5% menos de energía en Jetson Nano que el modelo de referencia YOLOv8n seleccionado manualmente, con una pérdida de solo ~2% en el mAP de detección. Lograr tal equilibrio manualmente sería muy difícil.

2. Generalización mejorada: Los modelos descubiertos por NAS pueden adaptarse mejor a nuevas condiciones, ya que la búsqueda puede incorporar diversos datos u objetivos. El detector de diseño automático se generalizó bien a diferentes tipos de cultivos (trigo y algodón) y condiciones de iluminación. Esta amplia robustez es crucial cuando los vuelos se encuentran con escenarios inesperados.

3. Reducción del esfuerzo de ingeniería: NAS automatiza gran parte del proceso de prueba y error. En lugar de ajustar manualmente los tamaños de las capas y probar múltiples opciones, un NAS optimizado para la implementación explora iterativamente las alternativas y encuentra el diseño óptimo. Esto ahorra tiempo y experiencia en desarrollo, facilitando la actualización de los detectores para nuevas tareas o hardware.

4. Escalabilidad: Una vez configurado, el marco NAS puede utilizarse para diferentes plataformas o misiones de UAV. Por ejemplo, el mismo NAS, optimizado para el despliegue, podría buscar un detector ajustado a una resolución de cámara o modelo de dron diferente simplemente modificando los parámetros de entrada. Esto resulta mucho más escalable que rediseñar las redes desde cero para cada escenario.

Desafíos y limitaciones

El almacenamiento NAS con reconocimiento de implementación es potente, pero no es la solución definitiva. Debe aplicarse con criterio, teniendo en cuenta sus necesidades de recursos y la variabilidad del entorno de destino. A pesar de su potencial, el almacenamiento NAS con reconocimiento de implementación presenta desafíos:

1. Alto costo de búsqueda: El NAS puede requerir una gran capacidad de procesamiento. Incluso con algoritmos eficientes, la búsqueda en el espacio de arquitectura puede consumir muchas horas de GPU (o computación especializada). Si no se gestiona con cuidado, la sobrecarga de búsqueda podría resultar prohibitiva para algunos equipos.

2. Sesgo de datos y cambio de dominio: La eficacia del NAS depende de la calidad de los datos utilizados. Si las imágenes de entrenamiento no son representativas de las condiciones reales, la arquitectura resultante podría tener un rendimiento inferior al esperado. Por ejemplo, un modelo ajustado para un tipo de cultivo o una región geográfica podría no ser perfectamente aplicable a otros sin una adaptación adicional.

3. Heterogeneidad del hardware: El hardware para UAVs viene en diversas variantes (diferentes GPU, CPU y FPGA integradas). Un modelo optimizado para una placa puede no ser óptimo para otra. Los sistemas NAS con capacidad de implementación deben repetir las búsquedas para cada plataforma o usar restricciones conservadoras que se ajusten a todas, lo que puede limitar el rendimiento.

4. Limitaciones prácticas: Las implementaciones agrícolas reales implican cuestiones como las actualizaciones de red inalámbricas, la integración del sistema con el control de vuelo y la certificación de seguridad. Incluso el mejor modelo de sistema de navegación aérea (NAS) debe integrarse en un sistema completo de drones. La coordinación de las actualizaciones del modelo, las aprobaciones regulatorias y la capacitación de los agricultores son obstáculos que van más allá de lo técnico.

Direcciones futuras

Es probable que en el futuro se observe una integración aún más estrecha entre el diseño de modelos, la tecnología de sensores y el control de UAV. El NAS con capacidad de despliegue seguirá siendo una herramienta clave en este proceso de codiseño. De cara al futuro, surgen varias vías interesantes:

1. NAS en línea y adaptativo: En lugar de una búsqueda puntual sin conexión, los sistemas futuros podrían ajustar la red en tiempo real o entre vuelos. Por ejemplo, un dron podría partir de un modelo base y, mediante algoritmos NAS ligeros, adaptarse sobre la marcha para gestionar nuevas condiciones de iluminación o terreno. Este sistema NAS integrado en el dispositivo supone un gran desafío, pero podría mejorar considerablemente la adaptabilidad.

2. Codiseño de sensores y modelos: Los futuros sistemas de agricultura de precisión podrían optimizar conjuntamente la elección de la cámara (RGB, multiespectral, infrarroja) y la red neuronal. Los sistemas de búsqueda de redes neuronales (NAS) adaptados al entorno de implementación podrían incluir parámetros del sensor (como las bandas espectrales utilizadas) en su búsqueda, encontrando así la mejor combinación de hardware y modelo.

3. Integración multiespectral/hiperespectral: Como sugiere el estudio sobre enfermedades del algodón, la integración de imágenes multiespectrales puede mejorar la detección, especialmente de problemas en etapas tempranas. Los futuros sistemas de navegación aérea podrían explorar modelos de flujo múltiple que combinen canales RGB e infrarrojo cercano para detectar cambios sutiles en las plantas con mayor fiabilidad.

4. Canales de decisión autónomos: En última instancia, los detectores optimizados para NAS podrían contribuir a la autonomía total. Por ejemplo, un dron podría generar automáticamente un plan de fumigación o alertar a los administradores de la explotación si detecta ciertas condiciones. El NAS con capacidad de implementación podría extenderse a flujos de trabajo integrales (modelos de detección y acción), optimizando así todo el sistema.

5. Consideraciones éticas y medioambientales: A medida que los vehículos aéreos no tripulados (VANT) se vuelven más capaces, debemos considerar la privacidad, la seguridad del espacio aéreo y el impacto en la mano de obra agrícola (como señalan Agrawal y Arafat). Garantizar que los drones optimizados para el espacio aéreo nacional se utilicen de forma responsable en la agricultura es un objetivo importante para el futuro.

Conclusión

El algoritmo NAS, optimizado para el despliegue, representa una potente herramienta para diseñar detectores de objetos ligeros para la monitorización de cultivos mediante UAV. Al incorporar el hardware del UAV y las restricciones de la misión en la búsqueda, genera modelos que ahorran computación y energía sin sacrificar demasiada precisión. Por ejemplo, un trabajo reciente demostró que un detector diseñado con NAS utiliza 37% menos operaciones de punto flotante (FLOPs) y 61% menos parámetros que el detector de referencia YOLOv8n, pero su mAP se redujo en tan solo ~2%.

En el hardware real de los drones, esto se tradujo en una inferencia 28% más rápida y una eficiencia energética 18% superior. Estas mejoras se traducen en tiempos de vuelo más prolongados, análisis más rápidos y un soporte agrícola más eficaz. En comparación con los modelos creados manualmente, el NAS con reconocimiento de despliegue ofrece una mejor generalización del rendimiento, menor esfuerzo de ajuste manual y escalabilidad a nuevas plataformas de UAV.

En el contexto de la agricultura de precisión, estas mejoras pueden hacer que el monitoreo de cultivos mediante UAV sea más práctico y efectivo. Los drones equipados con detectores optimizados para NAS pueden detectar con mayor fiabilidad malezas, plagas o estrés, lo que permite intervenciones oportunas que ahorran recursos y aumentan los rendimientos. A medida que la agricultura continúa adoptando drones e IA, el NAS con enfoque en el despliegue desempeñará un papel fundamental para garantizar que los modelos que se ejecutan en esos drones sean eficientes, precisos y estén listos para su uso en el campo. Cierra la brecha entre la investigación de vanguardia en redes neuronales y las necesidades prácticas de los agricultores, impulsando así el futuro de la agricultura de precisión basada en datos.