Jęczmień górski, odporna roślina zbożowa uprawiana w wysokogórskich regionach chińskiego płaskowyżu Qinghai-Tybet, odgrywa kluczową rolę w lokalnym bezpieczeństwie żywnościowym i stabilności gospodarczej. Znany naukowo jako Hordeum vulgare L., roślina ta dobrze rośnie w ekstremalnych warunkach – rozrzedzonym powietrzu, niskim stężeniu tlenu i średniej rocznej temperaturze wynoszącej 6,3°C – co sprawia, że jest niezastąpiona dla społeczności żyjących w trudnych warunkach środowiskowych.

Jęczmień górski, z ponad 270 000 hektarów przeznaczonych na uprawę w Chinach, głównie w Regionie Autonomicznym Xizang, stanowi ponad połowę powierzchni upraw w tym regionie i ponad 701 ton sześciennych (TP3T) całkowitej produkcji ziarna. Dokładne monitorowanie zagęszczenia jęczmienia – liczby roślin lub kłosów na jednostkę powierzchni – jest niezbędne do optymalizacji praktyk rolniczych, takich jak nawadnianie i nawożenie, oraz prognozowania plonów.

Jednak tradycyjne metody, takie jak ręczne pobieranie próbek czy obrazowanie satelitarne, okazały się nieefektywne, pracochłonne lub niewystarczająco szczegółowe. Aby sprostać tym wyzwaniom, naukowcy z Uniwersytetu Rolnictwa i Leśnictwa w Fujianie oraz Uniwersytetu Technologicznego w Chengdu opracowali innowacyjny model sztucznej inteligencji oparty na YOLOv5, najnowocześniejszym algorytmie wykrywania obiektów.

Ich praca opublikowana w Metody roślinne (2025) osiągnął niezwykłe wyniki, w tym średnią precyzję (mAP) wynoszącą 93,1% — wskaźnik mierzący ogólną dokładność wykrywania — i redukcję kosztów obliczeniowych o 75,6%, co czyni go odpowiednim do stosowania w przypadku dronów w czasie rzeczywistym.

Wyzwania i innowacje w monitorowaniu upraw

Znaczenie jęczmienia górskiego wykracza poza jego rolę jako źródła pożywienia. Tylko w 2022 roku w Rikaze, regionie będącym głównym producentem jęczmienia, zebrano 408 900 ton jęczmienia na obszarze 60 000 hektarów, co stanowiło prawie połowę całkowitej produkcji zboża w Tybecie.

Pomimo znaczenia kulturowego i ekonomicznego, szacowanie plonów jęczmienia od dawna stanowi wyzwanie. Tradycyjne metody, takie jak ręczne liczenie czy zdjęcia satelitarne, są albo zbyt pracochłonne, albo nie zapewniają wystarczającej rozdzielczości, aby wykryć pojedyncze kłosy jęczmienia – części rośliny, w której znajduje się ziarno, często o szerokości zaledwie 2–3 centymetrów.

Ręczne pobieranie próbek wymaga od rolników fizycznej inspekcji poszczególnych fragmentów pola – procesu powolnego, subiektywnego i niepraktycznego w przypadku dużych gospodarstw rolnych. Zdjęcia satelitarne, choć przydatne do szerokich obserwacji, borykają się z niską rozdzielczością (często 10–30 metrów na piksel) i częstymi zakłóceniami pogodowymi, takimi jak zachmurzenie w regionach górskich, takich jak Tybet.

Aby pokonać te ograniczenia, naukowcy sięgnęli po bezzałogowe statki powietrzne (UAV), czyli drony, wyposażone w kamery o rozdzielczości 20 megapikseli. Drony te wykonały 501 zdjęć w wysokiej rozdzielczości pól jęczmienia w mieście Rikaze w dwóch krytycznych fazach wzrostu: fazie wzrostu w sierpniu 2022 roku, charakteryzującej się zielonymi, rozwijającymi się kłosami, oraz fazie dojrzewania w sierpniu 2023 roku, charakteryzującej się złocistożółtymi, gotowymi do zbioru kłosami.

Jednak analiza tych obrazów stwarzała pewne trudności, m.in. ze względu na rozmyte krawędzie spowodowane ruchem drona, niewielki rozmiar kłosów jęczmienia na zdjęciach lotniczych oraz nakładanie się kłosów na gęsto obsianych polach.

Aby rozwiązać te problemy, badacze przetworzyli obrazy wstępnie, dzieląc każdy obraz o wysokiej rozdzielczości na 35 mniejszych podobrazów i filtrując rozmyte krawędzie, co zaowocowało 2970 wysokiej jakości podobrazami do treningu. Ten etap wstępnego przetwarzania zapewnił, że model skoncentrował się na przejrzystych, użytecznych danych, unikając zakłóceń pochodzących z obszarów o niskiej jakości.

Postęp techniczny w wykrywaniu obiektów

Kluczowym elementem tych badań jest algorytm YOLOv5 (You Only Look Once, wersja 5), jednoetapowy model detekcji obiektów, znany ze swojej szybkości i modułowej konstrukcji. W przeciwieństwie do starszych modeli dwuetapowych, takich jak Faster R-CNN, które najpierw identyfikują obszary zainteresowania, a następnie klasyfikują obiekty, YOLOv5 przeprowadza detekcję w jednym przejściu, co znacznie przyspiesza proces.

Bazowy model YOLOv5n, z 1,76 miliona parametrów (konfigurowalnych komponentów modelu AI) i 4,1 miliarda FLOP-ów (operacji zmiennoprzecinkowych, miary złożoności obliczeniowej), był już wydajny. Jednak wykrywanie drobnych, nakładających się skoków jęczmienia wymagało dalszej optymalizacji.

Zespół badawczy wprowadził do modelu trzy kluczowe udoskonalenia: splot rozdzielny pod względem głębokości (DSConv), splot widmowy (GhostConv) i moduł uwagi bloku splotowego (CBAM).

Głęboko rozdzielny splot (DSConv) zmniejsza koszty obliczeniowe poprzez podzielenie standardowego procesu splotu – operacji matematycznej wyodrębniającej cechy z obrazów – na dwa etapy. Najpierw splot głębinowy nakłada filtry na poszczególne kanały kolorów (np. czerwony, zielony, niebieski), analizując każdy kanał oddzielnie.

Następnie następuje splot punktowy, który łączy wyniki z różnych kanałów za pomocą jąder 1×1. To podejście redukuje liczbę parametrów nawet o 75%.

Na przykład tradycyjny splot 3×3 z 64 kanałami wejściowymi i 128 kanałami wyjściowymi wymaga 73 728 parametrów, podczas gdy DSConv redukuje tę liczbę do zaledwie 8768 – co stanowi redukcję o 88%. Ta wydajność ma kluczowe znaczenie w przypadku wdrażania modeli na dronach lub urządzeniach mobilnych o ograniczonej mocy obliczeniowej.

Splot duchów (GhostConv) jeszcze bardziej upraszcza model, generując dodatkowe mapy cech — uproszczone reprezentacje wzorców obrazu — za pomocą prostych operacji liniowych, takich jak obrót lub skalowanie, zamiast wymagających dużych zasobów splotów.

Tradycyjne warstwy splotu generują zbędne cechy, marnując zasoby obliczeniowe. GhostConv rozwiązuje ten problem, tworząc “widma” cech z istniejących, co skutecznie zmniejsza o połowę parametry w niektórych warstwach.

Na przykład warstwa z 64 kanałami wejściowymi i 128 kanałami wyjściowymi tradycyjnie wymagałaby 73 728 parametrów, ale GhostConv redukuje to do 36,864 przy jednoczesnym zachowaniu dokładności. Ta technika jest szczególnie przydatna do wykrywania małych obiektów, takich jak kłosy jęczmienia, gdzie wydajność obliczeniowa ma kluczowe znaczenie.

Zintegrowano moduł uwagi bloków splotowych (CBAM), aby pomóc modelowi skupić się na kluczowych cechach, nawet w zatłoczonych środowiskach. Mechanizmy uwagi, inspirowane ludzkimi systemami wzrokowymi, pozwalają modelom AI nadawać priorytet ważnym elementom obrazu.

CBAM wykorzystuje dwa rodzaje uwagi: uwagę kanałową, która identyfikuje ważne kanały kolorów (np. zielony dla rosnących kolców) oraz uwagę przestrzenną, która podświetla kluczowe obszary obrazu (np. skupiska kolców). Zastępując standardowe moduły DSConv i GhostConv oraz włączając CBAM, naukowcy stworzyli uproszczony i precyzyjniejszy model dostosowany do wykrywania jęczmienia.

Wdrażanie i wyniki

Aby wytrenować model, badacze ręcznie oznaczyli 135 oryginalnych obrazów za pomocą ramek ograniczających – prostokątnych ramek oznaczających położenie kłosów jęczmienia – kategoryzując kłosy na fazy wzrostu i dojrzewania. Techniki augmentacji danych – w tym rotacja, wstrzykiwanie szumu, okluzja i wyostrzanie – rozszerzyły zbiór danych do 2970 obrazów, poprawiając zdolność modelu do generalizacji w różnych warunkach terenowych.

Na przykład, obracanie obrazów o 90°, 180° lub 270° pomogło modelowi rozpoznać impulsy pod różnymi kątami, jednocześnie dodając szum symulujący niedoskonałości świata rzeczywistego, takie jak kurz czy cienie. Zbiór danych podzielono na zbiór treningowy (80%) i zbiór walidacyjny (20%), co zapewniło solidną ocenę.

Trening odbył się na wydajnym systemie z procesorem AMD Ryzen 7, kartą graficzną NVIDIA RTX 4060 i 64 GB pamięci RAM, z wykorzystaniem frameworka PyTorch – popularnego narzędzia do głębokiego uczenia. Skrupulatnie śledzono ponad 300 epok treningowych (pełne przejścia przez zbiór danych), precyzję modelu (dokładność prawidłowych detekcji), wywoływalność (zdolność do znajdowania wszystkich istotnych impulsów) oraz stratę (współczynnik błędów).

Wyniki były uderzające. Ulepszony model YOLOv5 osiągnął precyzję 92,2% (w porównaniu z 89,1% w punkcie bazowym) i czułość 86,2% (w porównaniu z 83,1%), przewyższając model bazowy YOLOv5n o 3,1% w obu metrykach. Jego średnia precyzja (mAP) – kompleksowa metryka uśredniająca dokładność wykrywania we wszystkich kategoriach – osiągnęła 93,1%, z indywidualnymi wynikami 92,7% dla skoków w fazie wzrostu i 93,5% dla skoków w fazie dojrzewania.

Równie imponująca była jego wydajność obliczeniowa: parametry modelu spadły o 70,6% do 1,2 miliona, a liczba operacji na sekundę (FLOP) zmniejszyła się o 75,6% do 3,1 miliarda. Analizy porównawcze z wiodącymi modelami, takimi jak Faster R-CNN i YOLOv8n, podkreśliły jego wyższość.

Chociaż YOLOv8n osiągnął nieco wyższy mAP (93,8%), jego parametry (3,0 mln) i liczba operacji FLOP (8,1 mld) były odpowiednio 2,5x i 2,6x wyższe, co sprawia, że proponowany model jest znacznie wydajniejszy w aplikacjach czasu rzeczywistego.

Porównania wizualne podkreśliły te postępy. Na obrazach fazy wzrostu ulepszony model wykrył 41 pików w porównaniu z 28 na poziomie bazowym. W trakcie dojrzewania zidentyfikował 3 piki w porównaniu z 2 na poziomie bazowym, z mniejszą liczbą pominiętych detekcji (oznaczonych pomarańczowymi strzałkami) i wyników fałszywie dodatnich (oznaczonych fioletowymi strzałkami).

Te udoskonalenia są niezbędne dla rolników, którzy polegają na dokładnych danych, aby przewidywać plony i optymalizować zasoby. Na przykład, precyzyjne liczenie pędów umożliwia lepsze oszacowanie produkcji ziarna, a tym samym podejmowanie decyzji dotyczących terminu zbiorów, przechowywania i planowania rynku.

Przyszłe kierunki i praktyczne implikacje

Pomimo sukcesu, badanie ujawniło pewne ograniczenia. Wydajność spadała w ekstremalnych warunkach oświetleniowych, takich jak ostre olśnienie w południe lub gęste cienie, które mogą zasłaniać szczegóły kolców. Ponadto prostokątne pola ograniczające czasami nie pasowały do kolców o nieregularnym kształcie, co powodowało drobne niedokładności.

Model ten wykluczył również rozmyte krawędzie ze zdjęć wykonanych przez bezzałogowy statek powietrzny, co wymagało ręcznego wstępnego przetwarzania, co wydłużało proces i zwiększało jego złożoność.

Dalsze prace mają na celu rozwiązanie tych problemów poprzez rozszerzenie zestawu danych o obrazy wykonane o świcie, w południe i o zmierzchu, eksperymentowanie z adnotacjami w kształcie wielokątów (elastyczne kształty, które lepiej pasują do nieregularnych obiektów) i opracowanie algorytmów, które pozwolą lepiej radzić sobie z rozmazanymi obszarami bez konieczności ręcznej ingerencji.

Implikacje tych badań są znaczące. Dla rolników w regionach takich jak Tybet, model oferuje szacowanie plonów w czasie rzeczywistym, zastępując pracochłonne, ręczne liczenie automatyzacją opartą na dronach. Rozróżnienie faz wzrostu umożliwia precyzyjne planowanie zbiorów, redukując straty wynikające z przedwczesnych lub opóźnionych zbiorów.

Szczegółowe dane dotyczące gęstości szczytów – takie jak identyfikacja obszarów słabo zaludnionych lub przeludnionych – mogą stanowić podstawę strategii nawadniania i nawożenia, redukując zużycie wody i środków chemicznych. Oprócz jęczmienia, lekka architektura daje nadzieję na zastosowanie jej również w uprawach innych roślin, takich jak pszenica, ryż czy owoce, torując drogę do szerszych zastosowań w rolnictwie precyzyjnym.

Wniosek

Podsumowując, niniejsze badanie ilustruje transformacyjny potencjał sztucznej inteligencji w rozwiązywaniu problemów w rolnictwie. Udoskonalając YOLOv5 za pomocą innowacyjnych, lekkich technik, naukowcy stworzyli narzędzie, które łączy dokładność i wydajność – kluczowe dla rzeczywistego wdrożenia w środowiskach o ograniczonych zasobach.

Terminy takie jak mAP, FLOP i mechanizmy uwagi mogą wydawać się techniczne, ale ich znaczenie jest głęboko praktyczne: umożliwiają rolnikom podejmowanie decyzji w oparciu o dane, oszczędzanie zasobów i maksymalizację plonów. W miarę jak zmiany klimatu i wzrost populacji nasilają presję na globalne systemy żywnościowe, takie postępy będą niezbędne.

Dla rolników z Tybetu i innych krajów technologia ta oznacza nie tylko skok w wydajności rolnictwa, ale także promyk nadziei na zrównoważone bezpieczeństwo żywnościowe w niepewnej przyszłości.

Odniesienie: Cai, M., Deng, H., Cai, J. i in. Wykrywanie lekkiego jęczmienia górskiego na podstawie ulepszonego YOLOv5. Plant Methods 21, 42 (2025). https://doi.org/10.1186/s13007-025-01353-0

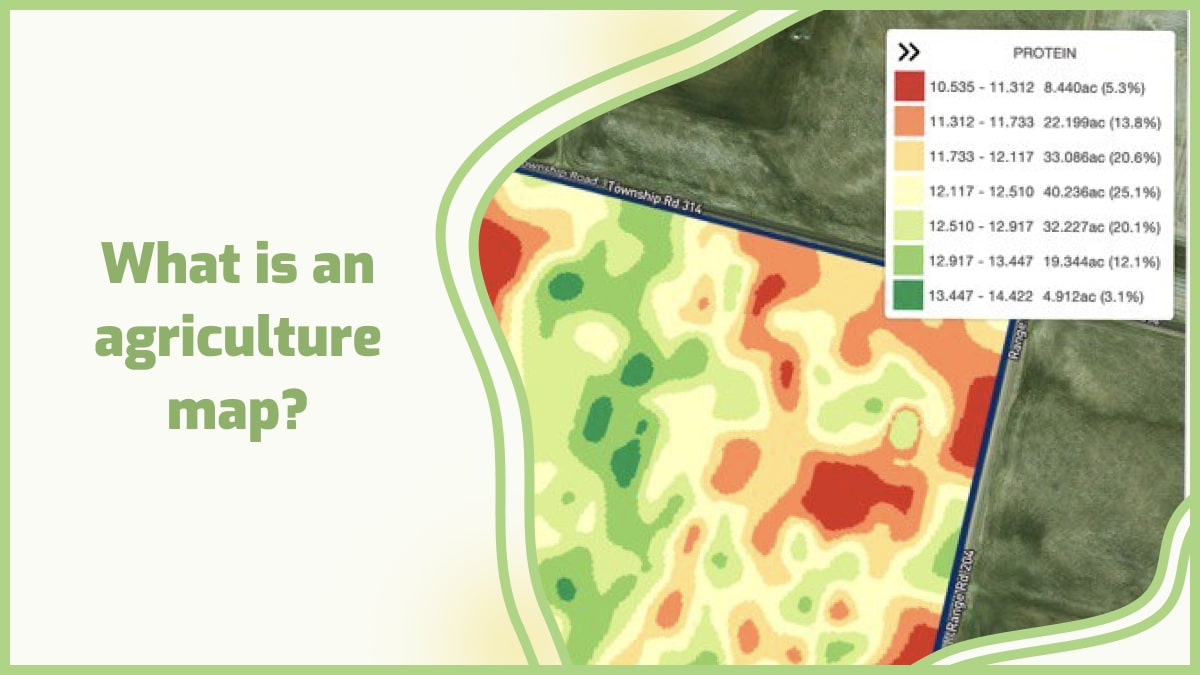

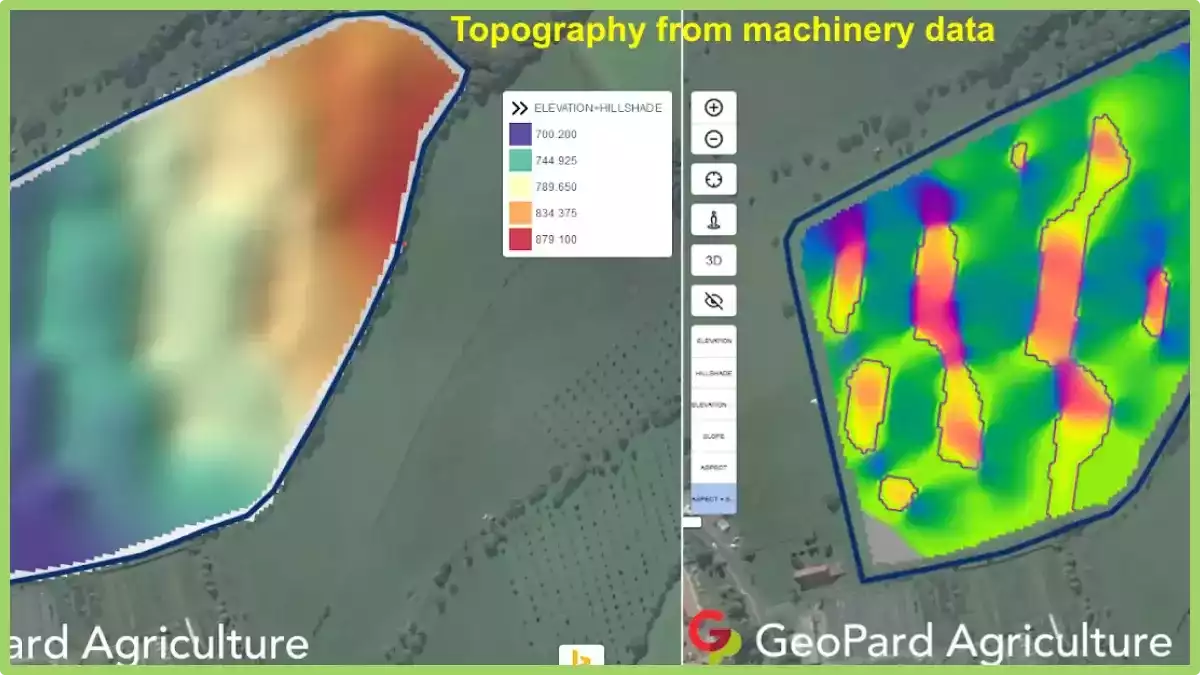

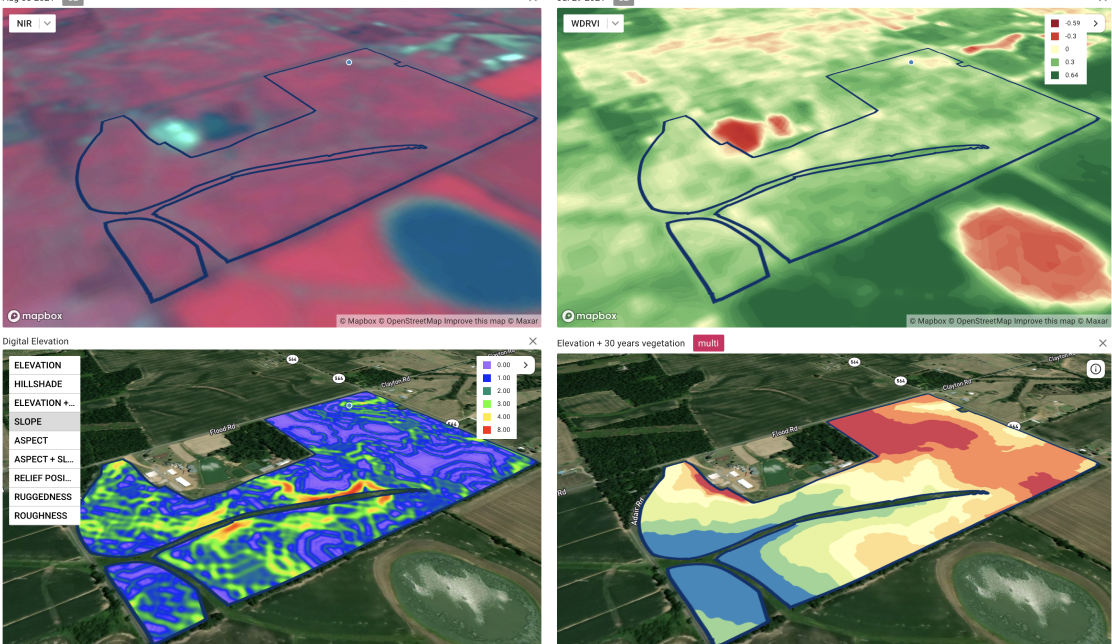

Oto jak działa mapowanie dronami: dron jest wyposażony w czujniki, takie jak kamery i skanery laserowe, które przelatują nad obszarem, rejestrując obrazy lub skanując go laserami na różnych wysokościach i pod różnymi kątami. Zebrane dane są następnie przetwarzane na mapy 3D, które można przeglądać na ekranie komputera lub smartfona.

Oto jak działa mapowanie dronami: dron jest wyposażony w czujniki, takie jak kamery i skanery laserowe, które przelatują nad obszarem, rejestrując obrazy lub skanując go laserami na różnych wysokościach i pod różnymi kątami. Zebrane dane są następnie przetwarzane na mapy 3D, które można przeglądać na ekranie komputera lub smartfona.

2. Mapy recepturowe nawozów, herbicydów i pestycydów z wykorzystaniem badań dronem

Tylko jedna strategia jest przestarzała, ponieważ nie tylko marnuje zasoby, ale może również wpływać na zdrowie i witalność upraw. Na przykład zbyt duża ilość wody może zniszczyć zdrowe rośliny, uniemożliwiając ich korzeniom wchłanianie tlenu, więc nawet regularne podlewanie nie jest najlepszym podejściem do uprawy nieskazitelnych plonów. To samo dotyczy nawozów; użycie odpowiedniej ilości ma kluczowe znaczenie dla wzrostu, ponieważ zbyt duża ilość powoduje spalenie korzeni, co może zniszczyć zdrowe rośliny. Mapowanie za pomocą dronów pozwala na rozpylanie oprysków tylko tam, gdzie występuje problem, zmniejszając marnotrawstwo zasobów i ryzyko uszkodzenia zdrowych upraw, które nie wymagają takiego samego traktowania. Podczas gdy ludzie nie byliby w stanie rozpoznać unikalnych potrzeb każdej rośliny w swojej uprawie, technologia badań dronów pozwala to zrobić w ciągu kilku minut.

3. Ocena upraw

Jednym naciśnięciem przycisku rozpoczyna się misja rozpoznawcza; dron opuszcza odporną na warunki atmosferyczne stację ładowania, zbiera dane i przesyła je do sieci. Wyniki uzyskane przez drona, a także analiza wykrywania stresu roślinnego oraz skuteczności wszelkich aktualnie stosowanych zabiegów lub modyfikacji, mogą zostać wykorzystane do dostosowania zautomatyzowanych systemów nawadniania. Dzięki dronom rozpoznawczym na miejscu możliwe są stałe kontrole stanu roślin.

4. Liczenie populacji roślin

Dzięki zaawansowanej technologii sztucznej inteligencji drona można zidentyfikować dowolną odmianę roślin. Pozwala to na określenie całkowitej produkcji i strat na początku i na końcu każdego sezonu, zwiększając precyzję i świadomość sukcesu sezonu wegetacyjnego.

5. Automatyczne klasyfikacje z wykorzystaniem obrazowania drona

Obrazowanie z drona pozwala określić rodzaj gruntów rolnych, nad którymi przelatuje – czy są to grunty orne, pastwiska czy tereny mieszane. Drony mogą również liczyć uprawy i zwierzęta gospodarskie, jak pokazano powyżej, aby zweryfikować aktualność danych i ewentualne straty.

6. Śledzenie upraw

Zdrowie upraw nie jest z góry przesądzone, ponieważ czynniki środowiskowe mogą wpływać na ich rozwój. Należy wziąć pod uwagę temperaturę, wilgotność, zawartość składników odżywczych i pierwiastków śladowych, obecność owadów i chorób, dostępność wody oraz nasłonecznienie. Wszystkie te czynniki można monitorować za pomocą różnych ładunków dronów, a wiele z tych niematerialnych zmiennych można kontrolować, stosując wodę lub opryski bezpośrednio na odpowiednie obszary. Im zdrowsze jest otoczenie uprawy, tym silniejszy staje się jej układ odpornościowy, a tym samym – staje się ona zdrowsza – i ma znacznie większą zdolność do odpierania szkodników i chorób.

2. Mapy recepturowe nawozów, herbicydów i pestycydów z wykorzystaniem badań dronem

Tylko jedna strategia jest przestarzała, ponieważ nie tylko marnuje zasoby, ale może również wpływać na zdrowie i witalność upraw. Na przykład zbyt duża ilość wody może zniszczyć zdrowe rośliny, uniemożliwiając ich korzeniom wchłanianie tlenu, więc nawet regularne podlewanie nie jest najlepszym podejściem do uprawy nieskazitelnych plonów. To samo dotyczy nawozów; użycie odpowiedniej ilości ma kluczowe znaczenie dla wzrostu, ponieważ zbyt duża ilość powoduje spalenie korzeni, co może zniszczyć zdrowe rośliny. Mapowanie za pomocą dronów pozwala na rozpylanie oprysków tylko tam, gdzie występuje problem, zmniejszając marnotrawstwo zasobów i ryzyko uszkodzenia zdrowych upraw, które nie wymagają takiego samego traktowania. Podczas gdy ludzie nie byliby w stanie rozpoznać unikalnych potrzeb każdej rośliny w swojej uprawie, technologia badań dronów pozwala to zrobić w ciągu kilku minut.

3. Ocena upraw

Jednym naciśnięciem przycisku rozpoczyna się misja rozpoznawcza; dron opuszcza odporną na warunki atmosferyczne stację ładowania, zbiera dane i przesyła je do sieci. Wyniki uzyskane przez drona, a także analiza wykrywania stresu roślinnego oraz skuteczności wszelkich aktualnie stosowanych zabiegów lub modyfikacji, mogą zostać wykorzystane do dostosowania zautomatyzowanych systemów nawadniania. Dzięki dronom rozpoznawczym na miejscu możliwe są stałe kontrole stanu roślin.

4. Liczenie populacji roślin

Dzięki zaawansowanej technologii sztucznej inteligencji drona można zidentyfikować dowolną odmianę roślin. Pozwala to na określenie całkowitej produkcji i strat na początku i na końcu każdego sezonu, zwiększając precyzję i świadomość sukcesu sezonu wegetacyjnego.

5. Automatyczne klasyfikacje z wykorzystaniem obrazowania drona

Obrazowanie z drona pozwala określić rodzaj gruntów rolnych, nad którymi przelatuje – czy są to grunty orne, pastwiska czy tereny mieszane. Drony mogą również liczyć uprawy i zwierzęta gospodarskie, jak pokazano powyżej, aby zweryfikować aktualność danych i ewentualne straty.

6. Śledzenie upraw

Zdrowie upraw nie jest z góry przesądzone, ponieważ czynniki środowiskowe mogą wpływać na ich rozwój. Należy wziąć pod uwagę temperaturę, wilgotność, zawartość składników odżywczych i pierwiastków śladowych, obecność owadów i chorób, dostępność wody oraz nasłonecznienie. Wszystkie te czynniki można monitorować za pomocą różnych ładunków dronów, a wiele z tych niematerialnych zmiennych można kontrolować, stosując wodę lub opryski bezpośrednio na odpowiednie obszary. Im zdrowsze jest otoczenie uprawy, tym silniejszy staje się jej układ odpornościowy, a tym samym – staje się ona zdrowsza – i ma znacznie większą zdolność do odpierania szkodników i chorób.