La cebada de las tierras altas, un cultivo de cereal resistente que se cultiva en las regiones de gran altitud de la meseta Qinghai-Tíbet de China, desempeña un papel fundamental en la seguridad alimentaria local y la estabilidad económica. Conocida científicamente como Hordeum vulgare Este cultivo, conocido como L., prospera en condiciones extremas (aire enrarecido, bajos niveles de oxígeno y una temperatura media anual de 6,3 °C), lo que lo hace indispensable para las comunidades que viven en entornos difíciles.

Con más de 270 000 hectáreas dedicadas a su cultivo en China, principalmente en la Región Autónoma de Xizang, la cebada de altura representa más de la mitad de la superficie cultivada de la región y más de 701 TP3T de su producción total de grano. El monitoreo preciso de la densidad de la cebada —el número de plantas o espigas por unidad de superficie— es esencial para optimizar las prácticas agrícolas, como el riego y la fertilización, y predecir los rendimientos.

Sin embargo, los métodos tradicionales, como el muestreo manual o las imágenes satelitales, han demostrado ser ineficientes, laboriosos o insuficientemente detallados. Para abordar estos desafíos, investigadores de la Universidad Agrícola y Forestal de Fujian y la Universidad Tecnológica de Chengdu desarrollaron un innovador modelo de IA basado en YOLOv5, un algoritmo de detección de objetos de vanguardia.

Su trabajo, publicado en Métodos de planta (2025), logró resultados notables, incluyendo una precisión media promedio (mAP) de 93,1%, una métrica que mide la precisión general de detección, y una reducción de 75,6% en los costos computacionales, lo que lo hace adecuado para despliegues de drones en tiempo real.

Desafíos e innovaciones en el monitoreo de cultivos

La importancia de la cebada de las tierras altas va más allá de su función como fuente de alimento. Tan solo en 2022, la ciudad de Rikaze, una importante región productora de cebada, cosechó 408.900 toneladas de cebada en 60.000 hectáreas, lo que representó casi la mitad de la producción total de cereales del Tíbet.

A pesar de su importancia cultural y económica, estimar el rendimiento de la cebada ha sido durante mucho tiempo un desafío. Los métodos tradicionales, como el conteo manual o las imágenes satelitales, son demasiado laboriosos o carecen de la resolución necesaria para detectar las espigas individuales de cebada, la parte de la planta que contiene el grano, que a menudo mide solo 2 o 3 centímetros de ancho.

El muestreo manual exige que los agricultores inspeccionen físicamente secciones de un campo, un proceso lento, subjetivo y poco práctico para explotaciones agrícolas de gran tamaño. Las imágenes satelitales, si bien son útiles para observaciones generales, presentan problemas debido a su baja resolución (a menudo de 10 a 30 metros por píxel) y a las frecuentes perturbaciones meteorológicas, como la nubosidad en regiones montañosas como el Tíbet.

Para superar estas limitaciones, los investigadores recurrieron a vehículos aéreos no tripulados (VANT), o drones, equipados con cámaras de 20 megapíxeles. Estos drones capturaron 501 imágenes de alta resolución de campos de cebada en la ciudad de Rikaze durante dos etapas críticas de crecimiento: la etapa de crecimiento en agosto de 2022, caracterizada por espigas verdes en desarrollo, y la etapa de maduración en agosto de 2023, marcada por espigas de color amarillo dorado, listas para la cosecha.

Sin embargo, el análisis de estas imágenes planteó dificultades, como los bordes borrosos causados por el movimiento del dron, el pequeño tamaño de las espigas de cebada en las vistas aéreas y la superposición de espigas en campos densamente sembrados.

Para abordar estos problemas, los investigadores preprocesaron las imágenes dividiendo cada imagen de alta resolución en 35 subimágenes más pequeñas y filtrando los bordes borrosos, lo que dio como resultado 2970 subimágenes de alta calidad para el entrenamiento. Este paso de preprocesamiento garantizó que el modelo se centrara en datos claros y útiles, evitando distracciones causadas por regiones de baja calidad.

Avances técnicos en la detección de objetos

El elemento central de esta investigación es el algoritmo YOLOv5 (You Only Look Once versión 5), un modelo de detección de objetos de una sola etapa conocido por su velocidad y diseño modular. A diferencia de los modelos más antiguos de dos etapas, como Faster R-CNN, que primero identifican las regiones de interés y luego clasifican los objetos, YOLOv5 realiza la detección en una sola pasada, lo que lo hace significativamente más rápido.

El modelo base YOLOv5n, con 1,76 millones de parámetros (componentes configurables del modelo de IA) y 4100 millones de FLOPs (operaciones de coma flotante, una medida de la complejidad computacional), ya era eficiente. Sin embargo, la detección de pequeñas espigas de cebada superpuestas requería una mayor optimización.

El equipo de investigación introdujo tres mejoras clave en el modelo: convolución separable en profundidad (DSConv), convolución fantasma (GhostConv) y un módulo de atención de bloques convolucionales (CBAM).

La convolución separable en profundidad (DSConv) reduce los costos computacionales al dividir el proceso de convolución estándar —una operación matemática que extrae características de las imágenes— en dos pasos. Primero, la convolución en profundidad aplica filtros a los canales de color individuales (por ejemplo, rojo, verde, azul), analizando cada canal por separado.

A continuación, se realiza una convolución punto a punto, que combina los resultados de todos los canales utilizando núcleos de 1×1. Este método reduce el número de parámetros hasta en 75%.

Por ejemplo, una convolución tradicional de 3×3 con 64 canales de entrada y 128 de salida requiere 73 728 parámetros, mientras que DSConv los reduce a tan solo 8 768, lo que supone una reducción de 88%. Esta eficiencia es fundamental para implementar modelos en drones o dispositivos móviles con capacidad de procesamiento limitada.

La convolución fantasma (GhostConv) aligera aún más el modelo al generar mapas de características adicionales (representaciones simplificadas de patrones de imagen) mediante operaciones lineales simples, como rotación o escalado, en lugar de convoluciones que consumen muchos recursos.

Las capas de convolución tradicionales generan características redundantes, lo que supone un desperdicio de recursos computacionales. GhostConv soluciona este problema creando características "fantasma" a partir de las existentes, reduciendo así a la mitad los parámetros en ciertas capas.

Por ejemplo, una capa con 64 canales de entrada y 128 canales de salida tradicionalmente requeriría 73.728 parámetros, pero GhostConv lo reduce a 36,864 manteniendo la precisión. Esta técnica es especialmente útil para detectar objetos pequeños como las espigas de cebada, donde la eficiencia computacional es primordial.

El módulo de atención de bloques convolucionales (CBAM) se integró para ayudar al modelo a centrarse en las características críticas, incluso en entornos complejos. Los mecanismos de atención, inspirados en los sistemas visuales humanos, permiten a los modelos de IA priorizar las partes importantes de una imagen.

CBAM emplea dos tipos de atención: atención de canal, que identifica canales de color importantes (por ejemplo, el verde para detectar espigas en crecimiento), y atención espacial, que resalta regiones clave dentro de una imagen (por ejemplo, grupos de espigas). Al reemplazar los módulos estándar con DSConv y GhostConv e incorporar CBAM, los investigadores crearon un modelo más eficiente y preciso, diseñado específicamente para la detección de cebada.

Implementación y resultados

Para entrenar el modelo, los investigadores etiquetaron manualmente 135 imágenes originales utilizando cuadros delimitadores (marcos rectangulares que marcan la ubicación de las espigas de cebada), clasificándolas según su etapa de crecimiento o maduración. Las técnicas de aumento de datos (que incluyen rotación, inyección de ruido, oclusión y nitidez) ampliaron el conjunto de datos a 2970 imágenes, mejorando así la capacidad del modelo para generalizar en diversas condiciones de campo.

Por ejemplo, rotar las imágenes 90°, 180° o 270° ayudó al modelo a reconocer picos desde diferentes ángulos, mientras que añadir ruido simuló imperfecciones del mundo real, como polvo o sombras. El conjunto de datos se dividió en un conjunto de entrenamiento (80%) y un conjunto de validación (20%), lo que garantizó una evaluación sólida.

El entrenamiento se realizó en un sistema de alto rendimiento con una CPU AMD Ryzen 7, una GPU NVIDIA RTX 4060 y 64 GB de RAM, utilizando el framework PyTorch, una herramienta popular para el aprendizaje profundo. Durante más de 300 épocas de entrenamiento (recorridos completos por el conjunto de datos), se realizó un seguimiento meticuloso de la precisión del modelo (exactitud de las detecciones correctas), la exhaustividad (capacidad para encontrar todos los picos relevantes) y la pérdida (tasa de error).

Los resultados fueron sorprendentes. El modelo YOLOv5 mejorado alcanzó una precisión de 92,21 TP3T (frente a 89,11 TP3T en el modelo de referencia) y una exhaustividad de 86,21 TP3T (frente a 83,11 TP3T), superando al modelo de referencia YOLOv5n en 3,11 TP3T en ambas métricas. Su precisión media promedio (mAP), una métrica integral que promedia la precisión de detección en todas las categorías, alcanzó 93,11 TP3T, con puntuaciones individuales de 92,71 TP3T para los picos en etapa de crecimiento y 93,51 TP3T para los picos en etapa de maduración.

Igualmente impresionante fue su eficiencia computacional: los parámetros del modelo se redujeron en 70,6% hasta alcanzar 1,2 millones, y las operaciones de punto flotante (FLOPs) disminuyeron en 75,6% hasta los 3.100 millones. Los análisis comparativos con modelos líderes como Faster R-CNN y YOLOv8n pusieron de manifiesto su superioridad.

Si bien YOLOv8n logró un mAP ligeramente superior (93,8%), sus parámetros (3,0 millones) y FLOPs (8,1 mil millones) fueron 2,5 y 2,6 veces superiores, respectivamente, lo que hace que el modelo propuesto sea mucho más eficiente para aplicaciones en tiempo real.

Las comparaciones visuales pusieron de manifiesto estos avances. En las imágenes de la fase de crecimiento, el modelo mejorado detectó 41 picos frente a los 28 del modelo de referencia. Durante la maduración, identificó 3 picos frente a los 2 del modelo de referencia, con menos detecciones fallidas (marcadas con flechas naranjas) y falsos positivos (marcados con flechas moradas).

Estas mejoras son vitales para los agricultores que dependen de datos precisos para predecir los rendimientos y optimizar los recursos. Por ejemplo, el conteo preciso de espigas permite mejores estimaciones de la producción de grano, lo que facilita la toma de decisiones sobre el momento de la cosecha, el almacenamiento y la planificación del mercado.

Direcciones futuras e implicaciones prácticas

A pesar de su éxito, el estudio reconoció algunas limitaciones. El rendimiento disminuyó en condiciones de iluminación extremas, como el intenso resplandor del mediodía o las sombras profundas, que pueden ocultar los detalles de las púas. Además, en ocasiones, los cuadros delimitadores rectangulares no se ajustaban correctamente a las púas de forma irregular, lo que generaba pequeñas imprecisiones.

El modelo también excluyó los bordes borrosos de las imágenes de los drones, lo que requiere un preprocesamiento manual, un paso que añade tiempo y complejidad.

Los trabajos futuros pretenden abordar estos problemas ampliando el conjunto de datos para incluir imágenes capturadas al amanecer, al mediodía y al atardecer, experimentando con anotaciones en forma de polígono (formas flexibles que se adaptan mejor a objetos irregulares) y desarrollando algoritmos para gestionar mejor las regiones borrosas sin intervención manual.

Las implicaciones de esta investigación son profundas. Para los agricultores de regiones como el Tíbet, el modelo ofrece una estimación del rendimiento en tiempo real, sustituyendo los recuentos manuales, que requieren mucha mano de obra, por la automatización mediante drones. La distinción entre las diferentes etapas de crecimiento permite una planificación precisa de la cosecha, reduciendo las pérdidas derivadas de una cosecha prematura o tardía.

Los datos detallados sobre la densidad de espigas —como la identificación de áreas con baja o alta densidad de plantas— pueden orientar las estrategias de riego y fertilización, reduciendo el desperdicio de agua y productos químicos. Además de la cebada, esta estructura ligera resulta prometedora para otros cultivos, como el trigo, el arroz o las frutas, lo que abre la puerta a aplicaciones más amplias en la agricultura de precisión.

Conclusión

En conclusión, este estudio ejemplifica el potencial transformador de la IA para abordar los desafíos agrícolas. Mediante el perfeccionamiento de YOLOv5 con técnicas innovadoras y ligeras, los investigadores han creado una herramienta que equilibra precisión y eficiencia, aspectos cruciales para su implementación práctica en entornos con recursos limitados.

Términos como mAP, FLOPs y mecanismos de atención pueden parecer técnicos, pero su impacto es profundamente práctico: permiten a los agricultores tomar decisiones basadas en datos, conservar recursos y maximizar los rendimientos. A medida que el cambio climático y el crecimiento demográfico intensifican la presión sobre los sistemas alimentarios mundiales, estos avances serán indispensables.

Para los agricultores del Tíbet y de otras regiones, esta tecnología representa no solo un gran avance en la eficiencia agrícola, sino también un faro de esperanza para la seguridad alimentaria sostenible en un futuro incierto.

Referencia: Cai, M., Deng, H., Cai, J. et al. Detección ligera de cebada de tierras altas basada en YOLOv5 mejorado. Plant Methods 21, 42 (2025). https://doi.org/10.1186/s13007-025-01353-0

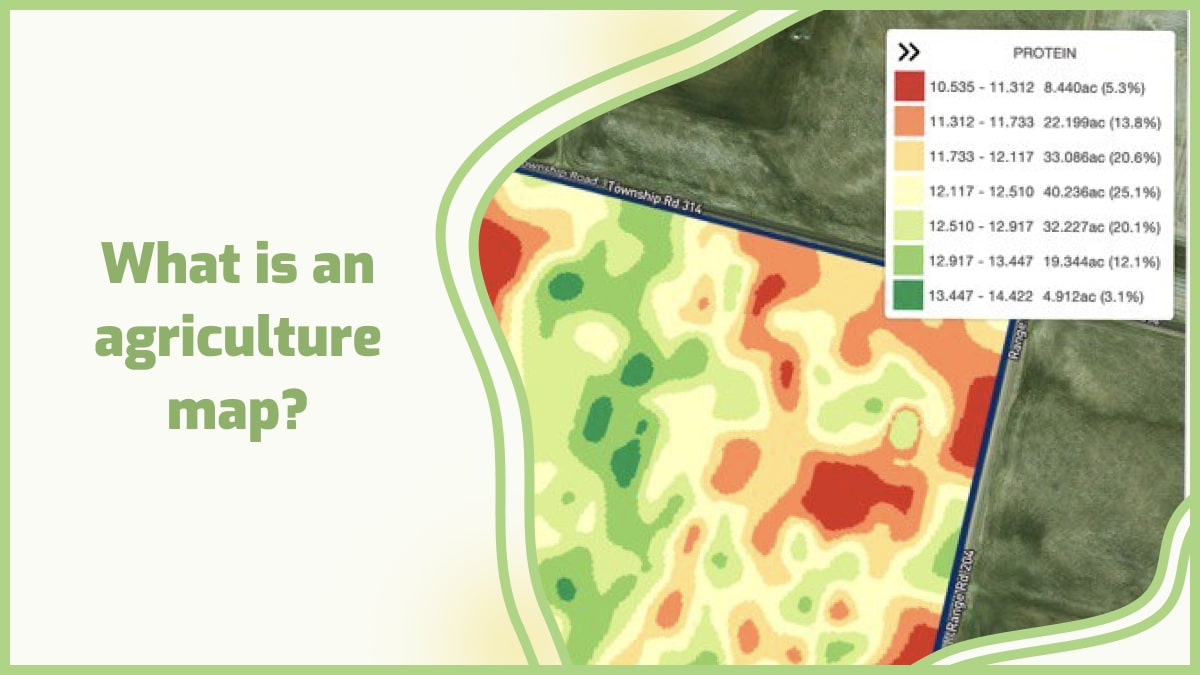

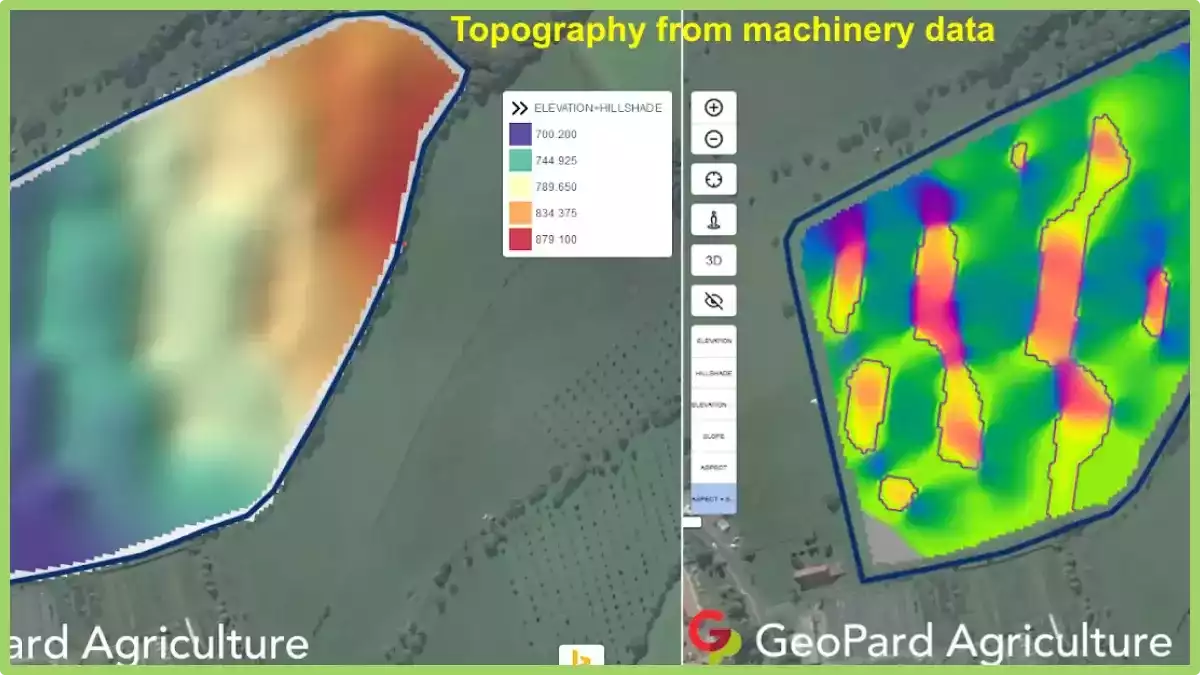

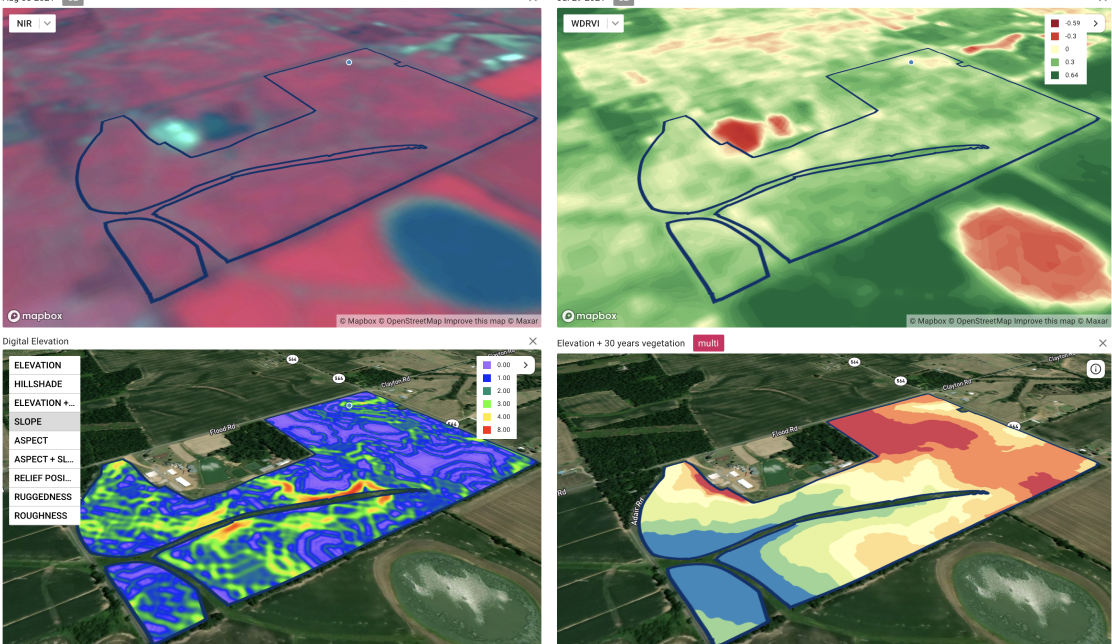

Así funciona el mapeo con drones: un dron equipado con sensores como cámaras y escáneres láser sobrevuela una zona capturando imágenes o escaneándola con láseres a diferentes altitudes y ángulos. Los datos recopilados se procesan para crear mapas 3D que se pueden visualizar en la pantalla de un ordenador o un teléfono inteligente.

Así funciona el mapeo con drones: un dron equipado con sensores como cámaras y escáneres láser sobrevuela una zona capturando imágenes o escaneándola con láseres a diferentes altitudes y ángulos. Los datos recopilados se procesan para crear mapas 3D que se pueden visualizar en la pantalla de un ordenador o un teléfono inteligente.

2. Mapas de prescripción de fertilizantes, herbicidas y pesticidas mediante levantamiento con drones.

Una estrategia en particular está desactualizada, ya que no solo desperdicia recursos, sino que también puede afectar la salud y vitalidad de los cultivos. El exceso de agua, por ejemplo, puede matar un cultivo sano al impedir que sus raíces absorban oxígeno; por lo tanto, incluso el riego no es la mejor manera de obtener cosechas perfectas. Lo mismo ocurre con los fertilizantes: usar la cantidad correcta es fundamental para el crecimiento, ya que un exceso provoca quemaduras en las raíces, lo que puede destruir plantas sanas. El mapeo con drones permite aplicar los herbicidas solo donde existe el problema, reduciendo el desperdicio de recursos y el riesgo de dañar cultivos sanos que no requieren el mismo tratamiento. Si bien los humanos no podrían reconocer las necesidades específicas de cada planta en su cultivo, la tecnología de reconocimiento con drones puede hacerlo en minutos.

3. Evaluación de cultivos

Con solo pulsar un botón, se inician las misiones de reconocimiento; el dron sale de la estación de carga resistente a la intemperie, recopila datos y los sube. Los resultados del dron, junto con un estudio de su capacidad para detectar el estrés de las plantas y la eficacia de los tratamientos o enmiendas actuales, pueden utilizarse para adaptar los sistemas de riego automatizados. Gracias a los drones de reconocimiento in situ, es posible realizar controles de salud constantes.

4. Recuento de la población de plantas

Gracias a la potente tecnología de IA del dron, se puede identificar cualquier variedad de plantas. Esto permite determinar la producción total y las pérdidas al inicio y al final de cada temporada, lo que aumenta la precisión y el conocimiento del éxito de la campaña de cultivo.

5. Clasificaciones automáticas con imágenes de drones

Las imágenes de los drones permiten identificar el tipo de terreno agrícola sobre el que vuelan: cultivable, de pastoreo o mixto. Los drones pueden contar la cantidad de cultivos y ganado, como se muestra arriba, para verificar que los registros estén actualizados y que se hayan anotado las pérdidas.

6. Seguimiento de los cultivos

La salud de los cultivos no está predeterminada, ya que los factores ambientales pueden influir en su desarrollo. La temperatura, la humedad, el contenido nutricional y de oligoelementos, la presencia de insectos y enfermedades, la disponibilidad de agua y la exposición al sol son elementos a considerar. Todos estos factores pueden monitorearse mediante las diferentes cargas útiles de los drones, y muchas de estas variables intangibles pueden controlarse aplicando agua o pesticidas directamente en las zonas afectadas. Cuanto más saludable sea el entorno del cultivo, más fuerte será su sistema inmunológico y, por lo tanto, más sano estará, con una mayor capacidad para combatir plagas y enfermedades.

2. Mapas de prescripción de fertilizantes, herbicidas y pesticidas mediante levantamiento con drones.

Una estrategia en particular está desactualizada, ya que no solo desperdicia recursos, sino que también puede afectar la salud y vitalidad de los cultivos. El exceso de agua, por ejemplo, puede matar un cultivo sano al impedir que sus raíces absorban oxígeno; por lo tanto, incluso el riego no es la mejor manera de obtener cosechas perfectas. Lo mismo ocurre con los fertilizantes: usar la cantidad correcta es fundamental para el crecimiento, ya que un exceso provoca quemaduras en las raíces, lo que puede destruir plantas sanas. El mapeo con drones permite aplicar los herbicidas solo donde existe el problema, reduciendo el desperdicio de recursos y el riesgo de dañar cultivos sanos que no requieren el mismo tratamiento. Si bien los humanos no podrían reconocer las necesidades específicas de cada planta en su cultivo, la tecnología de reconocimiento con drones puede hacerlo en minutos.

3. Evaluación de cultivos

Con solo pulsar un botón, se inician las misiones de reconocimiento; el dron sale de la estación de carga resistente a la intemperie, recopila datos y los sube. Los resultados del dron, junto con un estudio de su capacidad para detectar el estrés de las plantas y la eficacia de los tratamientos o enmiendas actuales, pueden utilizarse para adaptar los sistemas de riego automatizados. Gracias a los drones de reconocimiento in situ, es posible realizar controles de salud constantes.

4. Recuento de la población de plantas

Gracias a la potente tecnología de IA del dron, se puede identificar cualquier variedad de plantas. Esto permite determinar la producción total y las pérdidas al inicio y al final de cada temporada, lo que aumenta la precisión y el conocimiento del éxito de la campaña de cultivo.

5. Clasificaciones automáticas con imágenes de drones

Las imágenes de los drones permiten identificar el tipo de terreno agrícola sobre el que vuelan: cultivable, de pastoreo o mixto. Los drones pueden contar la cantidad de cultivos y ganado, como se muestra arriba, para verificar que los registros estén actualizados y que se hayan anotado las pérdidas.

6. Seguimiento de los cultivos

La salud de los cultivos no está predeterminada, ya que los factores ambientales pueden influir en su desarrollo. La temperatura, la humedad, el contenido nutricional y de oligoelementos, la presencia de insectos y enfermedades, la disponibilidad de agua y la exposición al sol son elementos a considerar. Todos estos factores pueden monitorearse mediante las diferentes cargas útiles de los drones, y muchas de estas variables intangibles pueden controlarse aplicando agua o pesticidas directamente en las zonas afectadas. Cuanto más saludable sea el entorno del cultivo, más fuerte será su sistema inmunológico y, por lo tanto, más sano estará, con una mayor capacidad para combatir plagas y enfermedades.